谷歌的人工智能分析工具Google Lens现在可以识别谷歌零售商品超过10亿种。这是它自2017年10月首次亮相以来所识别产品数量的四倍。

Google Lens副总裁Aparna Chennapragada在一篇关于Google Lens里程碑的回顾博文中披露了这一消息。

她写道:“我花了十年时间,领导团队通过谷歌搜索、谷歌助手和现在的Google Lens构建使用人工智能帮助人们识别日常生活中的产品。每一个醒着的时刻,我们依靠我们的视觉来理解我们的环境,记住各种信息,探索我们周围的世界。我看到相机开创了一整套新的信息发现和记录的机会。”

在本文中所说的产品是指产品标签。Google Lens利用了光学字符识别引擎,这是一种借鉴了谷歌搜索引擎,使用AI来识别不同字符、语言和字体、拼写校正模型的系统。光学字符识别引擎可以匹配Google Shopping中不同类别产品的条形码,二维码,ISBN号和其他字母数字标识符。

当然,并非所有Google Lens的计算机视觉算法都能识别。

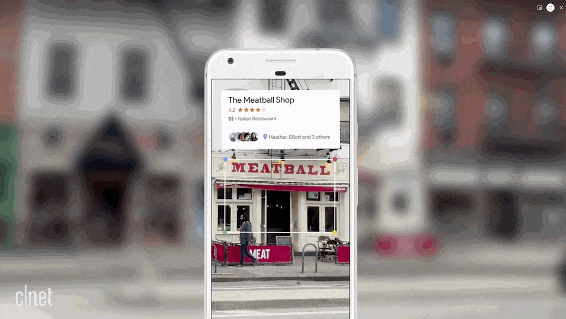

随着不断更新的名词,包括家具,服装,书籍,电影,音乐专辑,视频游戏,地标,兴趣点,着名建筑,Wi-Fi网络名称和密码,鲜花,宠物,视频游戏,饮料,名人等。镜头会读取并提示您使用菜单或者提示语进行操作,当指向服装或家居装饰时,建议使用风格相似的应用项目来识别。它还可以自动从名片中提取电话号码,日期和地址,并将它们添加到您的联系人列表中。

Google Lens在过去一年中发生了巨大变化。根据Chennapragada的说法,Google Lens通过谷歌的开源TensorFlow机器学习框架进行了标记图像培训,由于数据集的图片“看起来像是用智能手机拍摄的照片”,因此可以更可靠地识别物体,并显示在商品列表之中。

早在5月份的I / O大会演讲中,Google就为Lens提供了实时分析模式,这一功能率先在Pixel 3和3XL上发布。最近,谷歌通过谷歌应用程序将Lens带到iOS,并在Android和iOS上推出了重新设计之后的体验。

至于Google Lens未来的发展方向,Chennapragada正在大力推动人工智能驱动的增强功能。

“展望未来,我相信我们正在进入一个新的计算阶段:相机时代”,她写道。“这些事物一起涌现出来,让人工智能和机器学习取得了令人瞩目的进步;手机拥有更实惠更强大的硬件;数十亿人开始使用他们的相机记录生活中的大小时刻。”